Aspectos éticos en la aplicación de Inteligencia Artificial para la Investigación Jurídica

Ethical aspects in the application of Artificial Intelligence for Legal Investigation.

Celina Hernández Armenta[1]

Universidad Nacional Autónoma de México

Francisco Rosendo Olivares [2]

Universidad UDFSM

Resumen

La presente investigación analiza los aspectos éticos en la implementación de la inteligencia artificial (IA) en la investigación jurídica, centrándose en cómo esta tecnología está redefiniendo los métodos de análisis y la automatización en el derecho. Se identifican tanto los avances como los desafíos éticos, tales como el sesgo algorítmico, los riesgos para la privacidad de los datos, y la necesidad de transparencia en el uso de IA. El estudio sigue un enfoque metodológico comparativo, evaluando la normativa internacional y casos relevantes en la aplicación de IA en entornos jurídicos. Además, se presentan los principales desafíos y principios éticos propuestos, tales como justicia, responsabilidad y privacidad, para ofrecer un marco ético que guíe el uso responsable de la IA en la investigación jurídica. Los resultados reflejan que, si bien la IA puede mejorar la eficiencia en la investigación, su implementación debe ser controlada por principios éticos claros para evitar violaciones de derechos humanos y asegurar un desarrollo justo y equitativo en el ámbito jurídico.

Palabras clave: Ética jurídica, Inteligencia artificial, Investigación jurídica, Marco ético, Sesgo algorítmico.

Abstract

This research analyzes the ethical aspects of implementing artificial intelligence (AI) in legal research, focusing on how this technology is redefining analysis methods and automation in law. Both advancements and ethical challenges are identified, such as algorithmic bias, data privacy risks, and the need for transparency in AI use. The study follows a comparative methodological approach, evaluating international regulations and relevant cases on AI applications in legal contexts. Additionally, some main ethical challenges and proposed ethical principles are presented, such as justice, responsibility, and privacy, to offer an ethical framework that guides the responsible use of AI in legal research. The results show that while AI can enhance research efficiency, its implementation must be governed by clear ethical principles to prevent human rights violations and ensure fair and equitable development in the legal field.

Keywords: Legal ethics, Artificial intelligence, Legal research, Ethical framework, Algorithmic bias.

Introducción

El uso e integración de Inteligencia Artificial (IA) en la investigación jurídica en México y el mundo representa un campo prometedor, pero también plantea importantes desafíos éticos y regulatorios. La Inteligencia Artificial, que destaca por su capacidad para procesar grandes cantidades de datos y tomar decisiones autónomas, ofrece un potencial significativo para transformar la investigación jurídica y la enseñanza del derecho. No obstante, aún no se ha implementado en sentido pleno en muchas partes del mundo, incluyendo México.

Aún, se puede visualizar su impacto en campos como la automatización en recolección y procesamiento de datos, el análisis de datos jurídicos cualitativos y cuantitativos, la predicción de resultados de casos, y la enseñanza del derecho en entornos virtuales asistidos por Inteligencias Artificiales, entre otros (Del Rey & Azar, 2023).

Desde una perspectiva ética, los desafíos incluyen temas como el sesgo algorítmico, la privacidad y la seguridad en el manejo y uso de datos. Los aspectos éticos en el uso de las Inteligencias Artificiales, analizada desde la legislación internacional, resalta la importancia de abordar estos desafíos de manera responsable. A nivel Internacional, se han tomado medidas para regular el campo de la IA, como la Ley de Iniciativa Nacional de Inteligencia Artificial en EE. UU. y la propuesta de regulación en la Unión Europea, reflejando la importancia de un enfoque serio y responsable. Estas iniciativas subrayan la necesidad de una colaboración ética entre humanos y máquinas inteligentes para avanzar hacia un país con uso consciente de las Inteligencias Artificiales, donde la tecnología impulsa la investigación y la educación hacia un futuro prometedor (Dulima, 2021).

Planteamiento de la problemática

El planteamiento del problema en el contexto de la aplicación de la IA en el campo jurídico se centra en el desafío de integrar esta tecnología emergente en la investigación jurídica de manera ética y eficaz. La relación entre el derecho y la inteligencia artificial es bidireccional y compleja. Por un lado, la IA se ha convertido en un área de interés para los investigadores jurídicos, quienes están preocupados por establecer un marco jurídico adecuado para enfrentar sus riesgos, lo que ha dado lugar al surgimiento de un incipiente Derecho de la inteligencia artificial. Por otro lado, la actividad jurídica misma está siendo transformada por la introducción paulatina de la IA en el derecho, con la combinación de técnicas de Big Data, aprendizaje automático y procesamiento del lenguaje natural, permitiendo el diseño de herramientas para automatizar tareas de investigación jurídicas que hasta ahora solo podían ser realizadas por investigadores jurídicos avanzados (Solar, 2020).

Por lo tanto, el principal problema reside en cómo integrar y desarrollar la Inteligencia Artificial en el ámbito de la investigación jurídica de manera que se respeten los principios éticos, se mantenga la calidad y precisión de la investigación jurídica y se aborden los desafíos singulares presentados por la automatización de tareas de investigación. Este desafío implica no solo el diseño de herramientas tecnológicas y metodologías adecuadas, sino también la adaptación y enriquecimiento del arsenal metodológico del jurista con nuevos enfoques alternativos o complementarios, para el tratamiento de problemas jurídicos.

Objetivos

El estudio sobre la aplicación de la Inteligencia Artificial en la investigación jurídica busca: esclarecer cómo esta tecnología está redefiniendo la academia jurídica; discernir su estado de integración; y los retos que presenta para la enseñanza y práctica del derecho. Al mismo tiempo, pretende profundizar en los desafíos éticos inherentes al uso de la inteligencia artificial en el ámbito de investigación y enseñanza del derecho.

Temas como el sesgo algorítmico y el uso de datos de forma eficiente y ética, para desarrollar un marco ético que guíe su implementación responsable, aseguran que la innovación tecnológica en el derecho esté alineada con los valores éticos y contribuya al avance de un sistema de investigación justo y equitativo. Este enfoque integrado proporcionará directrices esenciales para los investigadores y académicos, marcando el camino hacia una práctica de investigación que armonice la tecnología avanzada con la ética y el derecho.

Panorama actual de la aplicación de inteligencia artificial en el ámbito jurídico.

El uso de la Inteligencia Artificial en la investigación jurídica se encuentra en una fase de exploración y reconocimiento respecto de su potencial, para llevar a cabo investigaciones más exhaustivas y de mejor calidad. Aunque la implementación plena de la IA aún no es una realidad en los sistemas de investigación jurídica, existe un creciente interés en sus posibles aplicaciones.

La Inteligencia Artificial tiene el potencial de automatizar procesos de recolección y análisis de datos para investigaciones cuantitativas y cualitativas detallados, predecir resultados de casos hipotéticos con base en datos históricos, y ofrecer asistencia tanto de investigación como académica virtual a través de chatbots y asistentes virtuales, lo que podría incrementar el acceso a información y bases de datos extensas que garantizan eficientizar el trabajo de investigación jurídico (Gómez, 2022).

La visión a futuro contempla un sistema de investigación y enseñanza del derecho que se adapte efectivamente a las necesidades de la sociedad, usando la tecnología para garantizar investigaciones más accesibles, completas y con mejor rigor metodológico. Sin embargo, esta visión viene acompañada de desafíos significativos, especialmente en lo que respecta a la ética y la regulación de la IA.

La preocupación ética en torno a la Inteligencia Artificial ha aumentado a la par de su desarrollo, impulsando esfuerzos a nivel mundial para regular el campo. Ejemplos de ello incluyen: la Ley de Iniciativa Nacional de Inteligencia Artificial en Estados Unidos; la propuesta de regulación en la Unión Europea; así como, propuestas de reforma en México como la propuesta de ley titulada “Ley para la regulación ética de la Inteligencia Artificial para los Estados Unidos Mexicanos” que busca someter a los sistemas de alto riesgo a niveles elevados de solidez, seguridad y supervisión humana adecuada (Jabbour, 2023).

La necesidad de abordar la Inteligencia Artificial de manera ética y responsable es reconocida por los propios desarrolladores y usuarios potenciales. La preocupación principal es el lanzamiento prematuro de una tecnología para la cual, la sociedad aún no está completamente preparada, lo que podría causar un daño significativo a nivel social y jurídico (AP, 2023).

A pesar de esto, la perspectiva general es de optimismo cauteloso, centrado en las oportunidades que la inteligencia artificial puede brindar para mejorar la investigación y enseñanza del derecho y la toma de decisiones estratégicas. El futuro del derecho en México, impulsado por la Inteligencia Artificial, se imagina no como un reemplazo de los investigadores y profesionales jurídicos, sino como un complemento que les permita centrarse en tareas más complejas y estratégicas, combinando la creatividad y el razonamiento humano con la eficiencia y el análisis avanzado de la inteligencia artificial.

Desafíos éticos de la inteligencia artificial en la investigación jurídica.

La adopción de la Inteligencia Artificial en la investigación jurídica abre un nuevo horizonte de posibilidades para la eficiencia y la innovación de investigaciones jurídicas. Sin embargo, esta adopción no está exenta de desafíos éticos significativos. La inteligencia artificial, al procesar grandes cantidades de datos y realizar simulaciones y predicciones en escenarios hipotéticos, podría perpetuar y amplificar sesgos existentes si no se maneja con cautela, lo que plantea preocupaciones en la interpretación de datos, así como el uso indiscriminado en los ámbitos de investigación y enseñanza del derecho (Sánchez, 2022). Estos desafíos éticos requieren que los investigadores jurídicos y los desarrolladores de Inteligencia Artificial colaboren para establecer prácticas que promuevan la transparencia y la responsabilidad sobre el manejo eficiente y ético de la información.

Así como, la detección de plagio, los falsos positivos de uso de inteligencias artificiales y la interpretación de datos jurídicos son áreas donde la Inteligencia Artificial puede ofrecer ventajas significativas, pero también riesgos, los sistemas de inteligencia artificial diseñados para detectar el plagio pueden generar falsos positivos, poniendo en riesgo la reputación de investigadores inocentes (Chechitelli, 2023). Del mismo modo, la interpretación automatizada de datos jurídicos debe abordarse con escepticismo crítico para evitar conclusiones erróneas que podrían afectar los resultados de las investigaciones y los resultados de estos.

Asimismo, la educación y la capacitación en el uso ético de la Inteligencia Artificial son esenciales para los futuros investigadores y educadores del derecho. Deben estar equipados no solo con el conocimiento técnico, sino también con una comprensión profunda de las implicaciones éticas de la tecnología que utilizan. A medida que México se esfuerza por establecer un marco regulador para la Inteligencia Artificial, es crucial fomentar un enfoque equilibrado que aproveche los beneficios de la IA mientras se minimizan los riesgos éticos asociados. La meta es una integración de Inteligencia Artificial que respete los principios fundamentales del derecho y fortalezca la integridad de la investigación jurídica.

La integración de la inteligencia artificial en la investigación jurídica trae consigo una serie de desafíos éticos que requieren una consideración detenida por parte de los investigadores jurídicos, los desarrolladores de inteligencia artificial y los responsables políticos. Entre estos desafíos, se incluyen el sesgo algorítmico, los falsos positivos en la detección de plagio y la ética de los investigadores jurídicos al utilizar inteligencia artificial (Tabla 1). A continuación, se exploran estos temas en detalle:

|

Tabla 1. Desafíos éticos de la IA para la investigación jurídica |

|||

|

Desafío Ético |

Descripción |

Ejemplos/Casos Relevantes |

Autores/Estudios |

|

Sesgo Algorítmico |

Los algoritmos de IA pueden perpetuar sesgos sociales existentes, afectando la imparcialidad. |

Herramientas de predicción de riesgos en el ámbito penal. |

Sánchez (2022); Khan et al. (2021) |

|

Privacidad de Datos |

La IA puede comprometer la privacidad de datos sensibles, lo que es crítico en el ámbito jurídico. |

Fugas de información en sistemas automatizados de gestión de datos. |

Vestri (2021); GDPR en la UE |

|

Transparencia Algorítmica |

Los sistemas de IA son a menudo opacos, lo que dificulta su auditabilidad y confianza en sus resultados. |

Uso de IA para asesorar decisiones judiciales sin claridad en los procesos. |

Pombo (2022); Gómez (2022) |

|

Responsabilidad |

No siempre está claro quién es responsable de los errores o fallos derivados del uso de IA. |

Fallos en diagnósticos automatizados por sistemas de IA. |

Microsoft (2023); Jabbour (2023) |

- A) Sesgo Algorítmico

La Inteligencia Artificial opera basándose en algoritmos que aprenden a partir de grandes conjuntos de datos. Sin embargo, si estos datos contienen sesgos, los sistemas de IA también los replicarán. En el ámbito jurídico, un sesgo algorítmico podría traducirse en recomendaciones o toma de decisiones con tendencias erróneas a partir de sesgos cognitivos o sesgos sociales que estén incrustados en el procesamiento erróneo de las Inteligencias Artificiales, lo que plantea serios desafíos éticos, ya que se tendría que tener un entendimiento de que el uso de IA debe ser auxiliar para el estudiante de derecho, así como para el investigador jurídico, ya que si se llega a tener un uso indiscriminado de estas, es muy alta la tendencia a llegar a tener errores por parte de la información proporcionada por las Inteligencias Artificiales (Sánchez, 2022).

- B) Falsos Positivos en la Detección de Plagio

Las herramientas antiplagio pueden generar falsos positivos al evaluar trabajos jurídicos, especialmente si se utilizan algoritmos para comparar textos. Un falso positivo podría llevar a la desacreditación injusta de un investigador o al rechazo indebido de un artículo jurídico. Esto destaca la necesidad de tener mecanismos robustos y transparentes para la detección de plagio (Chechitelli, 2023).

- C) Ética de los Investigadores Jurídicos

Los investigadores jurídicos deben mantener un alto grado de ética al utilizar IA en sus investigaciones. Esto incluye ser transparentes sobre el uso de Inteligencia Artificial, entender y comunicar las limitaciones, y garantizar su uso de manera responsable y conforme a las normativas legales y éticas vigentes.

- D) La evaluación crítica de la Inteligencia Artificial

La evaluación crítica de la Inteligencia Artificial y la ética de los investigadores jurídicos están estrechamente relacionadas. Los investigadores deben ser capaces de comprender y evaluar las herramientas de IA que utilizan, conociendo sus capacidades y limitaciones. Deben aplicar la IA de forma responsable y transparente, garantizando su alineación con las normativas éticas y jurídicas. Esto incluye la comprensión de los principios fundamentales de la tecnología y la capacidad de cuestionar y validar los resultados proporcionados por los Sistemas de Inteligencia Artificial.

- E) Educación y Conciencia

La educación y la conciencia sobre estos desafíos éticos son fundamentales para los investigadores y estudiantes de derecho. Es imperativo que estén informados sobre los riesgos asociados con la IA y cómo mitigarlos (Pombo, 2022). Además, deben estar equipados con los conocimientos para utilizar la IA de manera que mejore la práctica legal y la interpretación del derecho, promoviendo la equidad y la justicia.

En conjunto, estos desafíos resaltan la necesidad de un marco ético sólido para la IA en la investigación y enseñanza del derecho. Un marco que fomente la transparencia, la equidad, la responsabilidad y la privacidad y que guíe la integración de la IA en la investigación jurídica.

Principios éticos para guiar la aplicación de inteligencia artificial en la investigación jurídica

Los principios éticos son esenciales para guiar la aplicación de la inteligencia artificial en la investigación jurídica, asegurando que su integración en el sistema tanto educativo como de investigación promueva el uso adecuado, criterios de citación correctos, así como imparcialidad al momento de la toma de decisiones. La UNESCO ha propuesto un estándar global sobre la ética de la Inteligencia Artificial que enfatiza en el ámbito de investigación y educación parámetros como: Impartir conocimientos adecuados en materia de IA¸ promover la adquisición de competencias previas para la educación en materia de IA, llevar a cabo iniciativas de investigación respecto del uso responsable y ético de tecnologías de IA en enseñanza, formación docente e investigación científica, así como apoyar y promover la colaboración cruzada entre la enseñanza de Técnicas de Inteligencia Artificial y aspectos éticos, sociales y educativos (UNESCO, 2022).

Este enfoque resalta la importancia de un marco ético en sentido especifico que sea inclusivo y respetuoso con la investigación y enseñanza del derecho en los que la transparencia, privacidad, uso adecuado de datos e imparcialidad son identificados como los principios éticos más comunes en la aplicación de la Inteligencia Artificial. Estos principios buscan asegurar que la IA no sea una caja negra inescrutable, sino que sus procesos y decisiones puedan ser entendidos y cuestionados por usuarios y expertos, manteniendo la confianza en su uso dentro del campo legal. La privacidad y la confidencialidad son especialmente críticas en la investigación jurídica, donde la protección de datos sensibles es fundamental (Khan et al., 2021).

Además, la responsabilidad y la imparcialidad son fundamentales para garantizar que la Inteligencia Artificial se utilice de manera que fomente la investigación y enseñanza del derecho y evite sesgos al momento de interpretar datos. Esto implica el diseño de Sistemas de Inteligencia Artificial libres de sesgos y el desarrollo de prácticas de recopilación de datos que reflejen la diversidad y complejidad de la sociedad.

Tanto los investigadores como los educadores en derecho que utilicen la Inteligencia Artificial de manera ética deben estar conscientes de estos principios y comprender cómo la IA puede ser defectuosa o sesgada (Cerny et al., 2019). La capacitación y la educación en ética de la inteligencia artificial son vitales para los profesionales del derecho, ya que les permiten aplicar la tecnología de manera informada y ética, cumpliendo con sus deberes profesionales y manteniendo la integridad del sistema jurídico.

La aplicación de la Inteligencia Artificial en el ámbito jurídico presenta oportunidades únicas para mejorar la eficiencia y el alcance de la investigación jurídica. Sin embargo, también plantea desafíos éticos que requieren una cuidadosa consideración y orientación. A continuación, se proponen varios principios éticos que podrían guiar la aplicación de Inteligencia Artificial en el ámbito de la investigación jurídica (Tabla 2):

|

Tabla 2. Principios éticos para guiar la aplicación de IA en la investigación jurídica. |

|||

|

Principio Ético |

Descripción |

Aplicabilidad en el Derecho |

Autores/Estudios |

|

Justicia y Equidad |

Garantizar que la IA se utilice de manera justa, evitando cualquier forma de discriminación. |

Desarrollo de herramientas de IA libres de sesgo en procedimientos judiciales. |

UNESCO (2022); Sánchez (2022) |

|

Privacidad y Confidencialidad |

Asegurar que, los datos manejados por la IA cumplan con los estándares más altos de privacidad y seguridad. |

Protección de datos sensibles en investigaciones jurídicas. |

Vestri (2021); GDPR en la UE |

|

Transparencia |

Los algoritmos utilizados deben ser comprensibles y auditables para garantizar la confianza en los resultados. |

Herramientas de predicción legal deben ser transparentes en sus procesos. |

Pombo (2022); Khan et al. (2021) |

|

Responsabilidad |

Establecer un marco claro de responsabilidad para los errores cometidos por los sistemas de IA. |

Definición clara de responsabilidad cuando se utiliza IA en investigaciones jurídicas. |

Jabbour (2023); Microsoft (2023) |

Transparencia: Los algoritmos y las metodologías empleadas por la Inteligencia Artificial y los investigadores jurídicos deben ser transparentes y comprensibles para los usuarios y las partes interesadas. Esto promoverá la confianza y permitirá una evaluación informada de la tecnología (Vestri, 2021).

Justicia y Equidad: La inteligencia artificial debe ser diseñada y utilizada de manera que promueva la justicia, evite la discriminación y garantice un trato equitativo para todos los individuos, independientemente de su origen, género o condición socioeconómica libre de todo sesgo (UNESCO, 2022).

Responsabilidad: Debe haber responsabilidad en la aplicación de la inteligencia artificial en el ámbito de la enseñanza y la investigación jurídica. Los datos o razonamientos desarrollados con la ayuda de la inteligencia artificial deben ser revisables y sujetas a citación, y debe existir un marco claro de responsabilidad por los errores o fallos que puedan resultar (Vestri, 2021).

Privacidad y Confidencialidad: La privacidad de los datos y la confidencialidad deben ser primordiales, especialmente dado que la información jurídica puede ser extremadamente sensible. Las prácticas de gestión de datos deben cumplir con las leyes y normativas vigentes sobre privacidad (Vestri, 2021).

Competencia y Educación: Los profesionales jurídicos que utilizan IA deben tener una comprensión adecuada de la tecnología, incluyendo sus limitaciones y potenciales sesgos. Esto incluye una formación continua para mantenerse al día con los desarrollos en Inteligencia Artificial.

Verificación y Validación: Los Sistemas de Inteligencia Artificial utilizados en la investigación jurídica deben ser verificables y validados para garantizar que funcionen como se espera y para mitigar los riesgos de errores, incluyendo falsos positivos en la detección de plagio (Microsoft, 2023).

Colaboración Multidisciplinaria: La colaboración entre juristas, científicos de datos, expertos en ética y de otras ramas es crucial para abordar los desafíos éticos de la Inteligencia Artificial en el ámbito jurídico. Esto puede ayudar a desarrollar soluciones más informadas y éticas.

Innovación Responsable: Fomentar la innovación en la aplicación de Inteligencia Artificial en el ámbito de la investigación jurídico, pero de manera que se alinee con los valores éticos y las normas sociales, promoviendo el bienestar y la justicia.

Estos principios éticos no son simplemente recomendaciones; son esenciales para una aplicación práctica y ética de la Inteligencia Artificial en el ámbito de la investigación jurídica. La adhesión a estos principios asegura que la IA sea una herramienta que fortalezca y no debilite la tanto la investigación como la enseñanza del derecho y la integridad de las investigaciones jurídicas. Con un enfoque ético sólido, la IA tiene el potencial de transformar el campo de investigación jurídica, promoviendo la eficiencia y la equidad, y mejorando la investigación y enseñanza del derecho.

Importancia de la ética en la aplicación de la Inteligencia Artificial en la investigación jurídica.

A medida que la tecnología avanza a pasos colosales, los sistemas de Inteligencia Artificial se están integrando en el ámbito jurídico en temas académicos, de investigación y enseñanza en el derecho con una rapidez y una capacidad que superan los marcos normativos y éticos existentes. Esta integración plantea preguntas fundamentales sobre cómo los principios éticos pueden y deben guiar la investigación jurídica en la era de la automatización y el análisis de datos masivos.

La IA ofrece oportunidades sin precedentes para la eficiencia y la precisión en la investigación jurídica. Sin embargo, la tecnología debe ser manejada con precaución para evitar la amplificación de sesgos preexistentes, proteger la privacidad de los datos y asegurar la pertinencia e idoneidad de las investigaciones y la equidad en los procesos de investigación y enseñanza del derecho. La prevención del sesgo algorítmico es una preocupación clave, ya que los algoritmos pueden replicar inadvertidamente las desigualdades sociales en sus resultados. Además, la precisión de las herramientas de Inteligencia Artificial, como aquellas utilizadas para la detección de plagio, debe ser impecable para evitar falsos positivos que podrían dañar la integridad académica y profesional.

La confidencialidad y la privacidad de los datos son de suma importancia en la investigación jurídica, donde la manipulación de información sensible es una constante. La Inteligencia Artificial debe implementarse de forma que respete las leyes de protección de datos y mantenga la confidencialidad, evitando así violaciones de la privacidad que podrían tener consecuencias jurídicas y personales graves.

Por otro lado, la educación y la competencia en Inteligencia Artificial son vitales para su aplicación ética. Los investigadores jurídicos deben estar bien versados en las capacidades y limitaciones de la IA, lo que requiere una educación continua y programas de capacitación que incluyan aspectos éticos de la tecnología.

Por último, la innovación responsable y la confianza en las investigaciones jurídicas son componentes fundamentales para una aplicación ética de la IA. La confianza pública en el sistema normativo depende de la transparencia y la responsabilidad en el uso de la Inteligencia Artificial. La adopción de un marco ético integral y general, como el establecido por la UNESCO, refleja la necesidad de un enfoque centrado en la persona que garantice que la IA se utilice de manera que promueva la imparcialidad y responsabilidad, respetando los derechos humanos y la dignidad.

Establecer los principios éticos no es solo una necesidad que tiene implicaciones teóricas, sino una obligación práctica para garantizar que la aplicación de la Inteligencia Artificial en la investigación jurídica se alinee con los más altos estándares de imparcialidad, equidad y respeto por los derechos humanos, manteniendo la confianza en un sistema de investigación justo y equitativo.

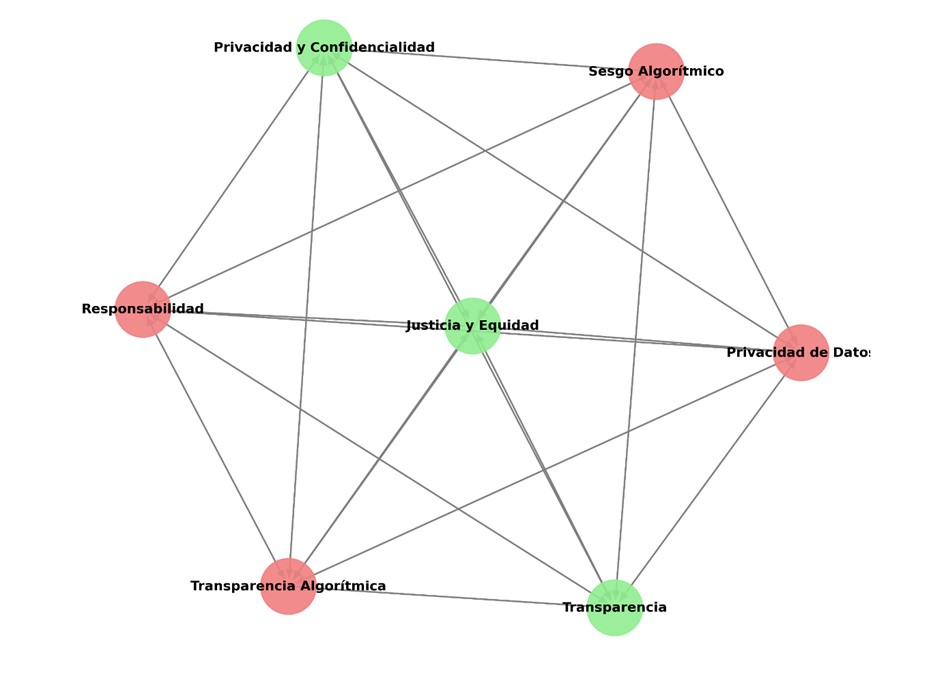

A continuación, se ha realizado un esquema que responde a la necesidad de visualizar de manera clara y sistémica las interrelaciones entre los desafíos éticos que surgen al implementar la IA en la investigación jurídica y los principios fundamentales que deben guiar su uso responsable (Figura 1). Dado que los desafíos y principios no actúan de manera aislada, sino que se encuentran profundamente interconectados de forma compleja y sistémica, la representación gráfica facilita la comprensión de cómo cada principio ético puede abordar y mitigar diversos desafíos.

Esta herramienta visual permite ilustrar la complejidad del marco ético necesario para el uso de Inteligencia Artificial, subrayando la importancia de un enfoque integral que considere la justicia, equidad, privacidad, transparencia y responsabilidad como elementos esenciales para garantizar un uso justo y seguro de las tecnologías emergentes en el ámbito jurídico.

De este modo, la gráfica no solo ofrece un análisis descriptivo, sino que también promueve un entendimiento holístico y multidimensional de los problemas y soluciones que al expresarse de forma visual dan un mejor entendimiento de como las relaciones entre desafíos y principios están interconectados para encontrar posibles soluciones en el uso de estas nuevas tecnologías emergentes.

Figura 1.

Relación Integral entre Desafíos y Principios Éticos en la Aplicación de la IA en la Investigación Jurídica.

La Figura 1 muestra la interconexión entre los principales desafíos éticos y los principios rectores necesarios para una implementación responsable de la inteligencia artificial (IA) en la investigación jurídica. Cada nodo representa un desafío (en rojo) o un principio ético (en verde). Las flechas indican cómo los principios y desafíos están interrelacionados, reflejando la naturaleza sistémica de la aplicación de IA en el derecho. Las conexiones bidireccionales entre los nodos subrayan cómo los principios éticos como la justicia, equidad, privacidad, transparencia y responsabilidad pueden mitigar y abordar los desafíos inherentes, tales como el sesgo algorítmico, la falta de transparencia, la privacidad de datos y la asignación de responsabilidades. Esta representación gráfica busca ilustrar la complejidad y las interdependencias en el marco ético necesario para la integración de IA en el ámbito jurídico.

Conclusiones

La integración de la Inteligencia Artificial en la investigación jurídica es un fenómeno que, aunque prometedor, viene acompañado de desafíos éticos significativos. La ética en la aplicación de la IA en este campo es esencial para garantizar que la tecnología se utilice de manera que refuerce los principios de imparcialidad y equidad, al tiempo que respeta el uso de datos y análisis de los mismos de forma eficiente y ética. A lo largo de este análisis, se analizaron distintos aspectos de la ética en la IA y cómo estos impactan en la investigación jurídica.

En resumen, la aplicación ética de la Inteligencia Artificial en la investigación jurídica es un imperativo que trasciende la eficiencia tecnológica. Requiere una consideración cuidadosa de cómo la IA puede utilizarse para fortalecer el sistema jurídico, promover la investigación académica y respetar los derechos humanos.

Solo mediante la adhesión a principios éticos claros y robustos, y con la participación de un espectro diverso de expertos, se puede garantizar que la Inteligencia Artificial sea una herramienta que enriquezca y no debilite la integridad de los procesos académicos, de investigación y enseñanza del derecho. Así, esta puede transformarse en un catalizador para el progreso en el ámbito jurídico, ofreciendo soluciones innovadoras que respeten y promuevan los principios éticos en las investigaciones jurídicas.

Referencias

- (2023). El director de ChatGPT pide una nueva agencia que regule la inteligencia artificial. Revista Proceso. https://www.proceso.com.mx/ciencia-tecnologia/2023/5/17/el-director-de-chatgpt-pide-una-nueva-agencia-que-regule-la-inteligencia-artificial-307151.html

Cerny, J., Delchin, S. & Nguyen, H. (2019). Legal ethics in the use of artificial intelligence. Squire Patton Boggs. https://www.squirepattonboggs.com/~/media/files/insights/publications/2019/02/legal-ethics-in-the-use-of-artificial-intelligence/legalethics_feb2019.pdf

Chechitelli, A. (2023, 24 de marzo). ¿Qué significan los falsos positivos en función de detección de escritura con IA? Turnitin. https://latam.turnitin.com/blog/que-significan-los-falsos-positivos-en-funcion-de-deteccion-de-escritura-con-ia#:~:text=Un%20falso%20positivo%20ocurre%20cuando,IA%2C%20es%20porque%20la%20hay.

Del Rey, F. & Azar, C. (2023). El papel de la inteligencia artificial en el derecho mexicano. CAPITEL. https://capitel.humanitas.edu.mx/el-papel-de-la-inteligencia-artificial-en-el-derecho-mexicano/

Dulima, T. (2021). La ética en inteligencia artificial desde la perspectiva del derecho. Universidad Santo Tomás, 16(2). https://www.redalyc.org/journal/5602/560269078009/html/

Gómez, J. M. (2022). Inteligencia artificial y neuroderechos. Revista Mexicana De Derecho Constitucional, 1(46), 93–119. https://doi.org/10.22201/iij.24484881e.2022.46.17049

Jabbour, G. (2023). La IA se está regulando pero como usuario tienes responsabilidades. Docta Magazine. https://doctamagazine.com/2023/04/29/la-ia-se-esta-regulando-pero-como-usuario-tienes-responsabilidades/

Khan, A. A., Liang, P., Waseem, M. & Khan, B. M. (2021). Ethics of AI: A Systematic Literature Review of Principles and Challenges [Ética de la IA: una revisión sistemática de la literatura sobre principios y desafíos]. arXiv. DOI:10.1145/3530019.3531329

Microsoft. (2023, 24 de septiembre). Promoción de prácticas de inteligencia artificial responsables. https://www.microsoft.com/es-mx/ai/responsible-ai

Pombo, C. (2022, 7 de diciembre). Los riesgos de la inteligencia artificial y algunas soluciones. Abierto al Público. https://blogs.iadb.org/conocimiento-abierto/es/riesgos-inteligencia-artificial/

Sánchez, M. (2022). Los riesgos de la inteligencia artificial para el principio de igualdad y no discriminación. ResearchGate https://www.researchgate.net/publication/361510404_Los_riesgos_de_la_inteligencia_artificial_para_el_principio_del_igualdad_y_no_discriminacion_planteo_de_la_problematica_y_algunas_aclaraciones_conceptuales_necesarias_bajo_el_prisma_del_Sistema_Intera

Solar, J. I. (2020). La inteligencia artificial jurídica: nuevas herramientas y perspectivas metodológicas para el jurista. Revus, 41. https://doi.org/10.4000/revus.6547

UNESCO. (2022). Recomendaciones sobre la ética de la inteligencia artificial. Organización de las Naciones Unidas para la Educación, la Ciencia y la Cultura. https://www.unesco.org/es/articles/recomendacion-sobre-la-etica-de-la-inteligencia-artificial

Vestri, G. (2021). La inteligencia artificial ante el desafío de la transparencia algorítmica: Una aproximación desde la perspectiva jurídico-administrativa. Revista Aragonesa de Administración Pública. (56), 385-387. https://dialnet.unirioja.es/servlet/articulo?codigo=7971161

Fecha de recepción: 18 de junio de 2024

Fecha de dictaminación: 20 de julio de 2024

Fecha de aceptación: 28 de septiembre de 2024

Fecha de publicación: 20 de diciembre de 2024

Celina Hernández Armenta: https://orcid.org/0009-0000-3098-4184

Francisco Rosendo Olivares: https://orcid.org/0000-0002-5580-2401

[1] 1Maestra en Derecho por la Universidad Nacional Autónoma de México.

[2] .Maestro en Derecho por la Universidad Nacional Autónoma de México, Profesor de Posgrado de la Universidad del Distrito Federal, Derecho Penal, Amparo, Campus Santa Maria.

La correspondencia referente a este artículo debe dirigirse a Celina Hernández Armenta, Correo electrónico: Esta dirección de correo electrónico está siendo protegida contra los robots de spam. Necesita tener JavaScript habilitado para poder verlo. o Francisco Rosendo Olivares , Correo electrónico: Esta dirección de correo electrónico está siendo protegida contra los robots de spam. Necesita tener JavaScript habilitado para poder verlo.